LLM-Markt Einordnung 2026: Was sich verändert hat

Wer im Frühjahr 2025 eine KI-Strategie formuliert hat, operiert heute mit veralteten Annahmen. In den vergangenen zwölf Monaten hat der LLM-Markt eine Konsolidierungsphase durchlaufen, die für Unternehmen weitreichende Konsequenzen hat: Modelle, die vor einem Jahr noch als State-of-the-Art galten, sind mittlerweile von ihren Nachfolgern weit überholt worden. Gleichzeitig hat sich das Open-Source-Ökosystem so weit entwickelt, dass die Frage "proprietär oder open-weight" zu einer vollwertigen Architekturentscheidung geworden ist — nicht mehr zur technischen Randnotiz.

Die gute Nachricht für Entscheider: Die Grundstruktur des Marktes ist überschaubarer geworden. Es gibt im Enterprise-Segment im Wesentlichen vier relevante Anbieterkategorien, deren Stärken und Schwächen sich klar benennen lassen. Eine nüchterne LLM-Markt Einordnung 2026 muss diese Kategorien sauber trennen — und bewusst auf Benchmark-Hype verzichten, der selten mit realen Unternehmensanforderungen korreliert.

Die vier Anbieterkategorien im Enterprise-Kontext

Eine ehrliche Markteinordnung muss zwischen dem unterscheiden, was Anbieter in Pressemitteilungen kommunizieren, und dem, was in Enterprise-Deployments tatsächlich relevant ist. Die folgenden vier Kategorien spiegeln die operative Realität wider, die wir in Projekten mit Mittelstands- und Enterprise-Kunden beobachten.

1. Frontier-Modelle: Proprietäre Anbieter mit vollständigem Enterprise-Stack

OpenAI (GPT-4o-Familie), Anthropic (Claude 3.x) und Google (Gemini Ultra/Pro) dominieren dieses Segment. Ihr Vorteil liegt nicht primär in der Modellqualität, sondern im integrierten Ökosystem: Enterprise-Verträge mit Datenverarbeitungsvereinbarungen, SOC-2-Zertifizierungen, SLA-Garantien und integrierten Sicherheitsfunktionen wie Prompt-Filter und Audit-Logs. Für Unternehmen mit hohen Compliance-Anforderungen ist dieser Stack der Weg des geringsten Widerstands — solange man bereit ist, die entsprechenden Lizenzkosten zu tragen und Datensouveränität zugunsten von Convenience aufzugeben. Der kritische Punkt: Alle drei Anbieter haben in den letzten Monaten ihre Preismodelle mehrfach angepasst, und Abhängigkeiten, die auf Basis von 2024-Preisen kalkuliert wurden, können 2026 signifikant teurer ausfallen.

2. Open-Weight-Modelle: Selbstgehostet oder Managed

Meta's Llama-Familie (aktuell Llama 3.x), Mistral und das chinesische Qwen-Modell von Alibaba haben die Leistungslücke zu proprietären Frontier-Modellen bei Standard-Aufgaben wie Textzusammenfassung, strukturierter Extraktion und Code-Generierung weitgehend geschlossen. Der entscheidende Vorteil: Volle Kontrolle über Deployment, Daten und Betriebskosten. Für Unternehmen, die DSGVO-konform eigene Daten verarbeiten wollen, ohne API-Traffic zu externen Anbietern zu senden, sind diese Modelle die technisch und regulatorisch sauberste Lösung. Der Preis dafür ist operationelle Komplexität: Eigene Infrastruktur, Modell-Updates, Sicherheitspatching und Monitoring müssen intern oder über einen Managed-Service-Anbieter abgedeckt werden. Für mittelgroße Unternehmen (ab ca. 500 Mitarbeitende) mit einer funktionierenden IT-Infrastruktur ist diese Option 2026 realistischer als noch vor zwei Jahren — die verfügbaren Managed-Hosting-Dienste wie Azure AI, AWS Bedrock und spezialisierte europäische Anbieter haben die Betriebshürden erheblich gesenkt.

3. Spezialisierte Modelle: Vertical AI für definierte Domänen

Eine dritte Kategorie, die in generischen Marktübersichten oft fehlt, sind spezialisierte Modelle für enge Domänen: medizinische Dokumentation (Med-PaLM, BioMedBERT), rechtliche Analyse, Finanzberichterstattung oder industrielle Codegenerierung. Diese Modelle sind in ihren Zieldomänen einem Frontier-Generalisten überlegen, weil sie auf domänenspezifischen Daten feinjustiert wurden. Für Unternehmen in regulierten Branchen oder mit sehr spezifischen, repetitiven Textaufgaben kann der Einsatz solcher Modelle trotz höherer initialer Integrationskosten das bessere ROI-Profil liefern.

4. Edge-Modelle: On-Device und latenzoptimiert

Kleine, hochoptimierte Modelle (Phi-3 Mini, Gemma 2B, Llama 3.2 1B/3B) für den Einsatz auf Endgeräten oder in latenzintensiven Szenarien — etwa Produktionsumgebungen ohne zuverlässige Internetverbindung oder Echtzeitanwendungen mit Reaktionszeiten unter 100ms. Dieser Bereich wächst schnell und ist für Branchen wie Logistik, Fertigung und Außendienst strategisch relevant. Die Modellqualität ist für komplexe Reasoning-Aufgaben begrenzt, aber für klar definierte, eng scopede Anwendungsfälle wie Formular-Vorausfüllung, Klassifikation oder Triage-Entscheidungen ausreichend.

Was Entscheider 2026 tatsächlich bewerten müssen

Die meisten LLM-Evaluierungen in Unternehmen scheitern daran, dass sie die falschen Kriterien priorisieren. Benchmark-Ergebnisse auf akademischen Datensätzen korrelieren schlecht mit der tatsächlichen Leistung auf unternehmenseigenen Aufgaben. Kontextfenstergröße und Tokengeschwindigkeit sind zwar messbar, aber für die meisten Business-Anwendungsfälle nicht der limitierende Faktor. Die drei Kriterien, die in der Praxis den größten Unterschied machen, sind folgende:

- Instruktionstreue bei strukturierten Aufgaben: Folgt das Modell zuverlässig komplexen System-Prompts mit mehreren Bedingungen? Gibt es konsistent valides JSON oder strukturierten Output zurück? Diese Dimension trennt tatsächlich nutzbare Modelle von solchen, die nur in Demo-Settings glänzen.

- Verhalten bei Grenzfällen und Fehleingaben: Wie verhält sich das Modell, wenn die Eingabe unvollständig, mehrdeutig oder außerhalb seines Trainingsbereichs liegt? Gibt es eine saubere Fehlermeldung zurück oder halluziniert es konfident falsche Antworten?

- Betriebliche Vorhersagbarkeit: Wie stabil ist das Modellverhalten über API-Versionen hinweg? Wann und wie kommuniziert der Anbieter Modell-Deprecations? Für produktive Systeme, die auf konsistenten Outputs basieren, ist diese Frage existenziell.

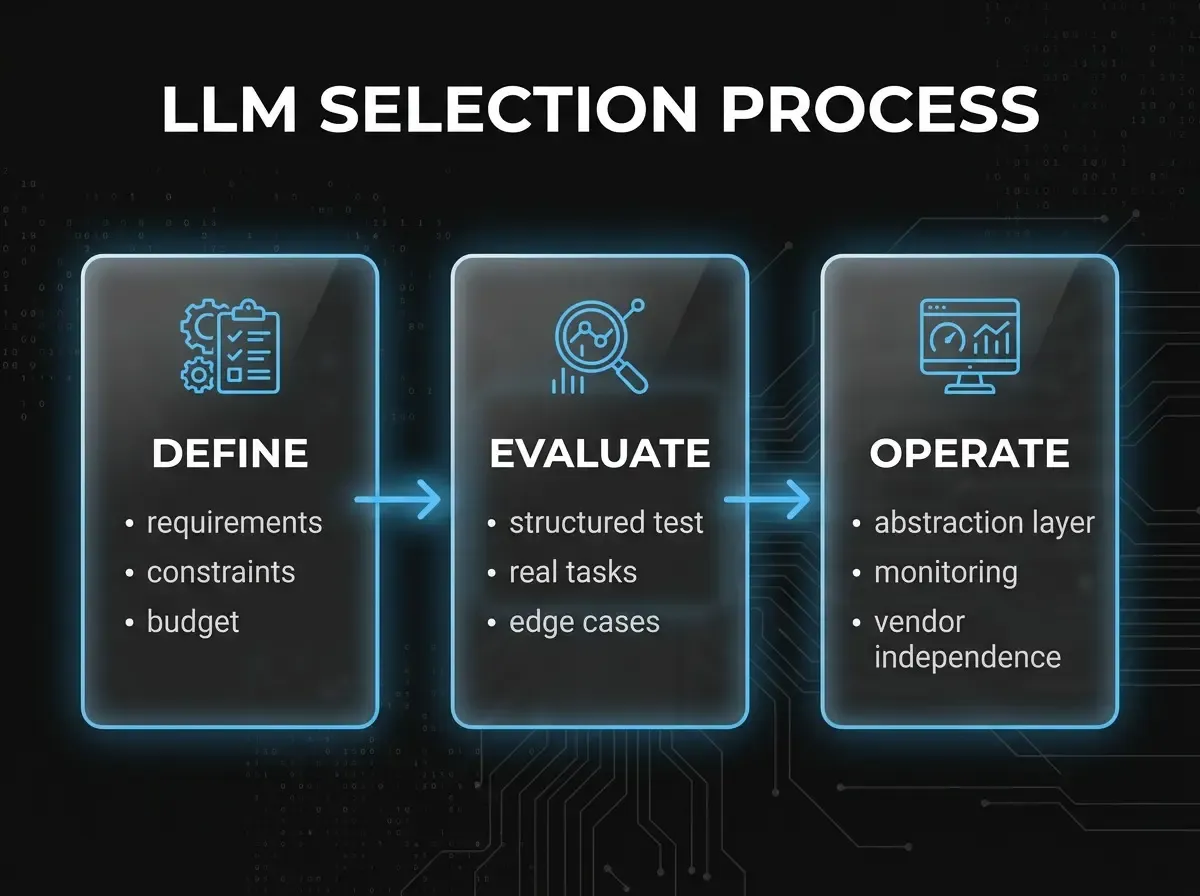

Vendor-Lock-in vermeiden: Die Abstraktionsschicht als strategische Pflicht

Das größte operative Risiko im aktuellen LLM-Markt ist nicht die falsche Modellwahl — es ist die direkte Integration eines spezifischen Modells in produktive Systeme ohne Abstraktionsschicht. Wer heute GPT-4o-Aufrufe direkt in seine Anwendungslogik codiert, hat morgen ein teures Migrationsprojekt, wenn OpenAI die Preise anhebt, das Modell depreciert oder ein Mitbewerber technisch gleichwertig aber deutlich günstiger wird. Die Lösung ist struktureller Natur: Ein Orchestrierungsframework (LangChain, LlamaIndex, proprietäre Middleware oder eine einfache Abstraktionsklasse) entkoppelt Geschäftslogik von Modellwahl und ermöglicht Anbieter-Switches ohne Systemumbau.

Dieser Punkt klingt technisch, hat aber eine direkte strategische Implikation: Unternehmen, die heute diese Abstraktionsschicht einbauen, behalten ihre Verhandlungsmacht gegenüber Anbietern. Wer das nicht tut, ist faktisch gebunden — und das wissen die Anbieter. Die Kosten für eine saubere Abstraktionsarchitektur sind einmalig und überschaubar; die Kosten eines erzwungenen Migrations-Sprints sind es nicht.

Die LLM-Markt Einordnung 2026 führt zu einem klaren Fazit: Der Markt hat eine Phase der Reife erreicht, in der technologische Differenzierung zwischen Top-Modellen geringer wird, während betriebliche und strategische Entscheidungen (Datensouveränität, Vendor-Unabhängigkeit, Abstraktionsarchitektur) an Bedeutung gewinnen. Unternehmen, die ihre KI-Architektur auf soliden operationellen Prinzipien aufbauen, werden von der weiteren Marktentwicklung profitieren — unabhängig davon, welcher Anbieter im nächsten Benchmark-Zyklus vorne liegt.