Warum die KI-Rollen-Verantwortliche-Matrix kein Papiertiger sein darf

Viele Unternehmen haben in den letzten Monaten eine KI-Nutzungsrichtlinie verabschiedet. Sie regelt, welche Tools erlaubt sind, was mit Unternehmensdaten passieren darf und welche Kategorien sensibler Informationen nicht in externe Systeme eingespielt werden sollen. Das ist ein guter erster Schritt — aber er reicht nicht aus. Eine Richtlinie ohne klare Rollenzuweisung ist ein frommer Wunsch, keine operative Governance.

Die entscheidende Frage lautet nicht "Was gilt?", sondern "Wer entscheidet, wer dokumentiert, wer eskaliert — und bis wann?" Genau hier setzt die KI-Rollen-Verantwortliche-Matrix an. Sie übersetzt abstrakte Governance-Anforderungen in konkrete Aufgaben und Zuständigkeiten, die im Alltag ohne lange Abstimmungsschleifen funktionieren.

Die vier Kernverantwortlichkeiten im Detail

Eine KI-Governance-Matrix muss nicht komplex sein — sie muss vollständig sein. In der Praxis hat sich ein Modell bewährt, das vier Kernverantwortlichkeiten unterscheidet. Jede davon ist einer oder mehreren Funktionen im Unternehmen zuzuordnen, mit klar definierten Erwartungen.

1. Freigabe: Wer entscheidet über den KI-Einsatz?

Bevor ein neues KI-Tool eingesetzt oder ein bestehendes auf neue Anwendungsfälle ausgeweitet wird, braucht es eine strukturierte Freigabe. In mittelgroßen Unternehmen liegt diese Verantwortung typischerweise bei einer Kombination aus IT-Leitung (technische Eignung und Sicherheitsbewertung), dem verantwortlichen Fachbereich (fachlicher Use-Case und Prozesseignung) und Legal oder Datenschutzbeauftragtem (regulatorische Prüfung nach DSGVO und EU AI Act). Die häufige Fehlannahme: dass der Datenschutzbeauftragte allein "die KI freigibt". In der Realität ist das eine gemeinsame Entscheidung — und genau das muss die Matrix abbilden.

2. Dokumentation: Wer hält fest, was passiert?

Im Kontext des EU AI Act und der DSGVO ist Nachweisbarkeit keine optionale Tugend — sie ist eine Compliance-Pflicht. Wer hat welches Modell mit welchen Eingabedaten genutzt? Welche Entscheidungen wurden durch KI-Ausgaben beeinflusst? Welche Korrekturen wurden vorgenommen? Die Dokumentationspflicht liegt primär beim nutzenden Fachbereich — aber die IT-Abteilung muss die technischen Voraussetzungen schaffen, etwa Audit-Logs und Zugriffsprotokolle. Ohne diese Abstimmung entstehen Dokumentationslücken, die im Fall einer Prüfung teuer werden können.

3. Überwachung: Wer prüft den laufenden Betrieb?

KI-Systeme verändern ihr Verhalten über Zeit — durch neue Modellversionen, veränderte Eingabedaten oder Verschiebungen im Nutzungskontext. Ein Sprachmodell, das im Januar auf Basis einer bestimmten Datenlage trainiert wurde, kann im Herbst auf neue Eingaben anders reagieren. Die Überwachungsverantwortung gehört in den Fachbereich, der das System täglich nutzt — dort fällt auf, wenn Outputs unplausibel werden. IT und Legal erhalten quartalsweise Berichte, greifen aber nur bei definierten Schwellenwerten aktiv ein. Diese "Ampellogik" verhindert, dass Überwachung entweder ignoriert oder zur überbürokratischen Daueraufgabe wird.

4. Eskalation: Wer handelt, wenn etwas schiefläuft?

Die Eskalationsverantwortung ist in vielen Organisationen am unklarsten definiert — und genau deshalb am kritischsten. Wenn ein KI-System einen offensichtlichen Fehler produziert, eine Datenpanne aufgedeckt wird oder eine regulatorische Anfrage eingeht, muss sofort klar sein: Wer informiert wen, in welcher Reihenfolge, innerhalb welcher Frist? Die Matrix legt fest, dass der Fachbereich die erste Eskalationsstufe trägt (Meldung innerhalb von 24 Stunden an IT-Leitung), dass Legal ab Schwellenwert 2 innerhalb von 48 Stunden eingebunden wird und die Geschäftsführung bei Reputations- oder Rechtsrisiken unmittelbar informiert wird.

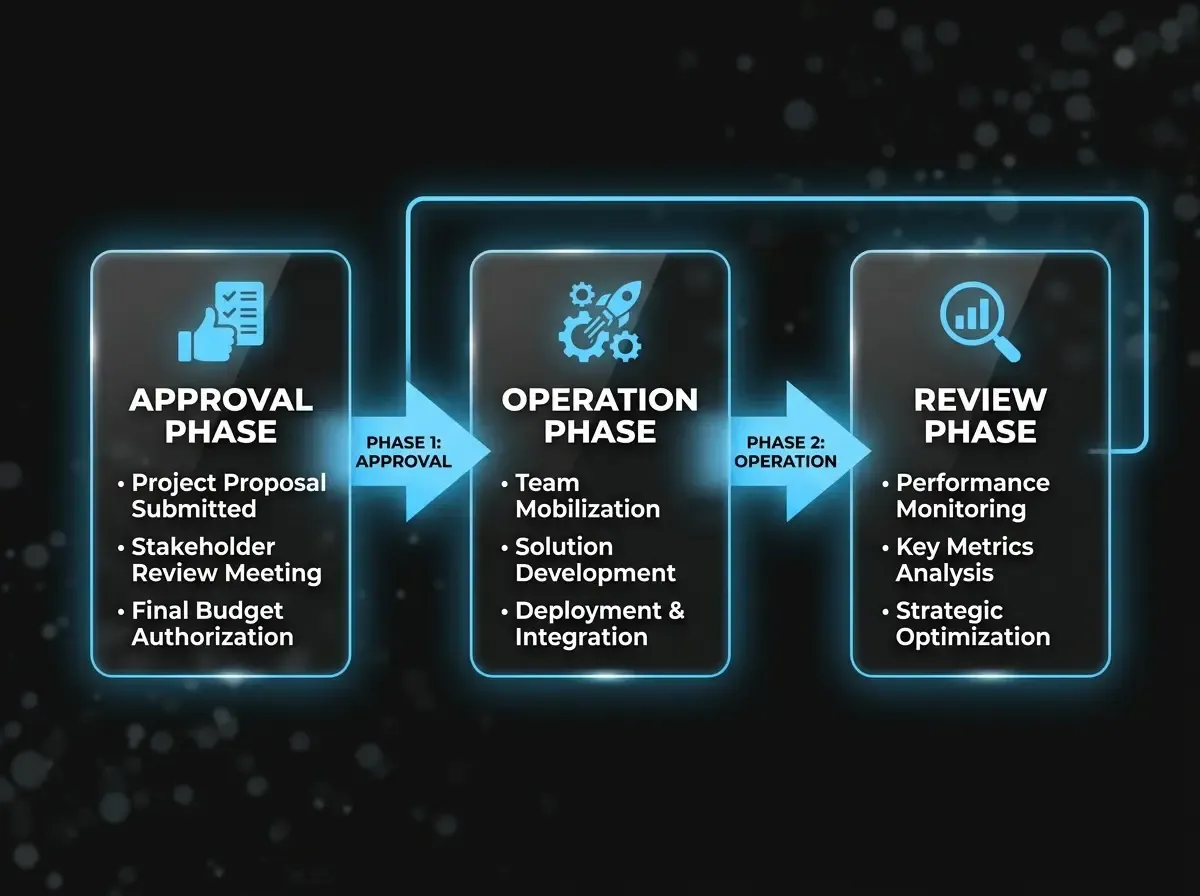

Wie die Matrix in der Praxis aussieht und gepflegt wird

Eine KI-Rollen-Verantwortliche-Matrix ist kein einmaliges Audit-Dokument, das nach seiner Erstellung im Intranet verstaubt. Sie muss als lebendiges Steuerungsinstrument behandelt werden. Das bedeutet konkret: Jede neue KI-Anwendung, die freigeschaltet wird, erhält einen eigenen Eintrag mit den vier zugewiesenen Verantwortlichkeiten. Bei Toolwechsel, Modellupdate oder Ausweitung des Anwendungsbereichs wird der Eintrag aktualisiert — idealerweise innerhalb von zwei Wochen nach der Änderung.

Erfahrungsgemäß empfiehlt sich ein tabellarisches Format mit folgenden Spalten: KI-Tool / Anwendungsfall, Risikokategorie (niedrig / mittel / hoch), verantwortlicher Fachbereich, Freigabe-Funktion, Dokumentationspflicht (Ja/Nein, Intervall), Überwachungsrhythmus und Eskalationspfad. Zusätzlich bewährt sich ein Verfallsdatum pro Zeile — ein Reminder, dass Genehmigungen nicht dauerhaft gelten, sondern periodisch bestätigt werden müssen.

Typische Stolpersteine beim Aufbau der Matrix

In der Praxis gibt es drei wiederkehrende Muster, die den Aufbau einer funktionierenden Rollenmatrix verzögern oder verwässern:

- Zu viele Funktionen in einer Verantwortlichkeit: Wenn fünf Personen für die Freigabe "zuständig" sind, ist niemand verantwortlich. Jede Verantwortlichkeit muss genau einer Funktion zugewiesen sein — mit einer klaren Vertretungsregelung, aber keiner geteilten Erstverantwortung.

- Keine Differenzierung nach Risikokategorie: Ein interner KI-Chatbot für HR-FAQs erfordert eine andere Governance als ein Modell, das Kreditentscheidungen unterstützt. Die Matrix muss Risikokategorien kennen und Verantwortlichkeiten entsprechend skalieren.

- Fehlende Verbindung zur operativen Realität: Wenn die Matrix in Legal entworfen wird, aber die Fachbereiche nie in den Entstehungsprozess einbezogen waren, wird sie nicht gelebt. Die wirksamsten Matrizen entstehen im Cross-Functional-Workshop — nicht am Schreibtisch der Rechtsabteilung.

Eine KI-Rollen-Verantwortliche-Matrix ist kein Compliance-Bürokratismus — sie ist das operative Rückgrat jeder ernsthaften KI-Strategie. Organisationen, die frühzeitig klare Zuständigkeiten definieren, können KI-Initiativen schneller skalieren, weil jede Freigabe auf einem belastbaren Fundament steht. Die, die es nicht tun, verlieren beim ersten Audit oder bei der ersten öffentlichen Diskussion über einen KI-Fehler wertvolle Zeit.