Warum diese Entscheidung so oft blockiert

Viele Mittelständler haben das interne LLM evaluiert, den Business Case gerechnet — und kommen dann zum Stillstand. Die häufigste Ursache ist nicht mangelnder Wille, sondern eine offen gelassene Grundsatzfrage: Wird das Modell intern betrieben oder über einen Cloud-Anbieter bezogen? IT, Datenschutz, Einkauf und Fachabteilung haben dabei oft konträre Anforderungen, die in keinem Meeting zusammengeführt wurden.

Das Problem: Diese Entscheidung wird gerne als technisches Detail behandelt, das die IT-Abteilung später klären soll. In der Praxis ist sie jedoch eine strategische Weichenstellung — sie bestimmt, wie viel Betriebsaufwand dauerhaft entsteht, wer Zugriff auf Modellinputs hat und wie flexibel das System bei steigender Nutzung bleibt. Wer sie zu spät trifft, baut Piloten auf Annahmen, die im Rollout nicht halten.

LLM On-Premise vs. Cloud im Vergleich: Die sechs Entscheidungsdimensionen

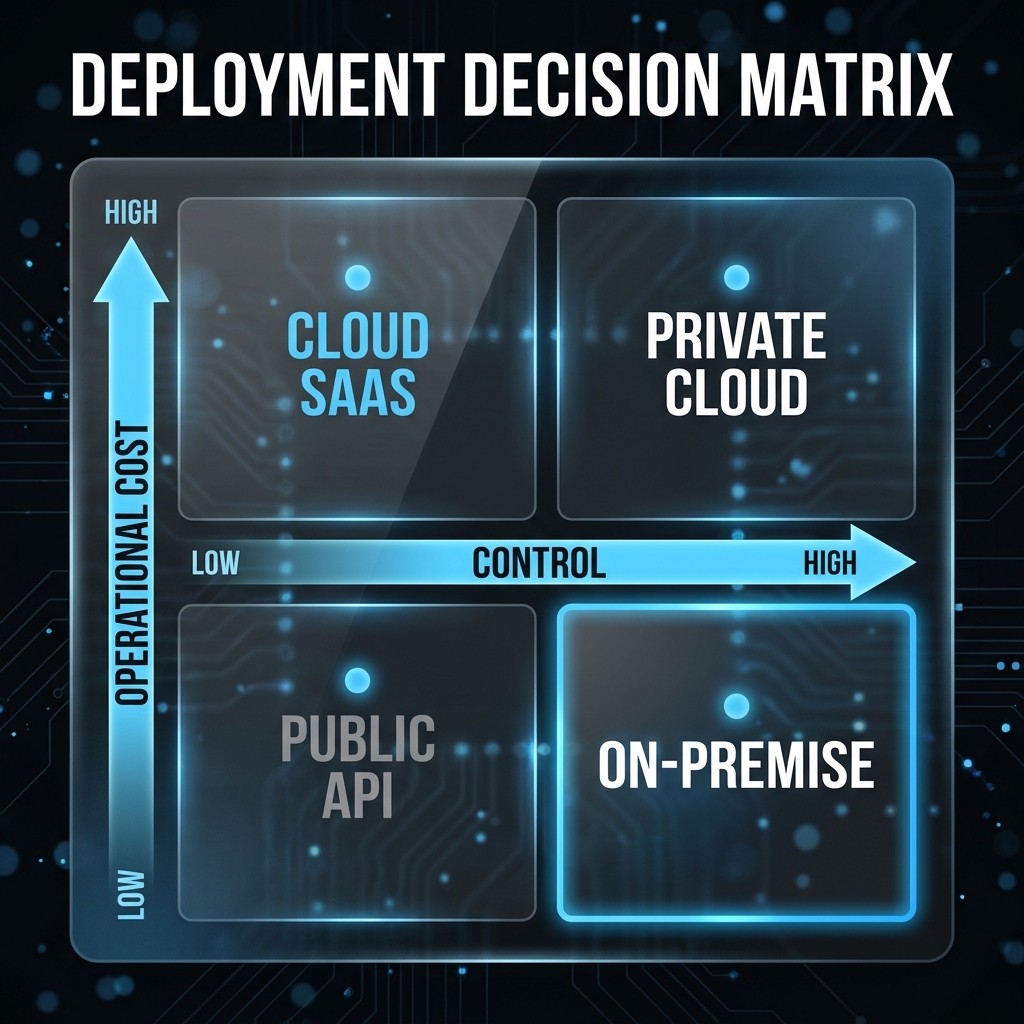

Eine belastbare Entscheidung für On-Premise oder Cloud kommt nicht aus einer einzigen Anforderung heraus. Sechs Dimensionen müssen gemeinsam bewertet werden — mit konkreten Ausprägungen je nach Unternehmenskontext.

1. Datenschutz & DSGVO: Cloud bedeutet nicht automatisch DSGVO-Verstoß — entscheidend sind Datenklasse, Verarbeitungsort und Auftragsverarbeitungsvertrag. Wer personenbezogene Daten verarbeitet oder vertrauliche Unternehmensdokumente in den Prompt einbettet, muss jedoch prüfen, ob das Modell diese Daten für Training nutzt. Viele Enterprise-Angebote schließen dies vertraglich aus. On-Premise gibt hier maximale Kontrolle, schiebt die Verantwortung aber komplett ins eigene Haus.

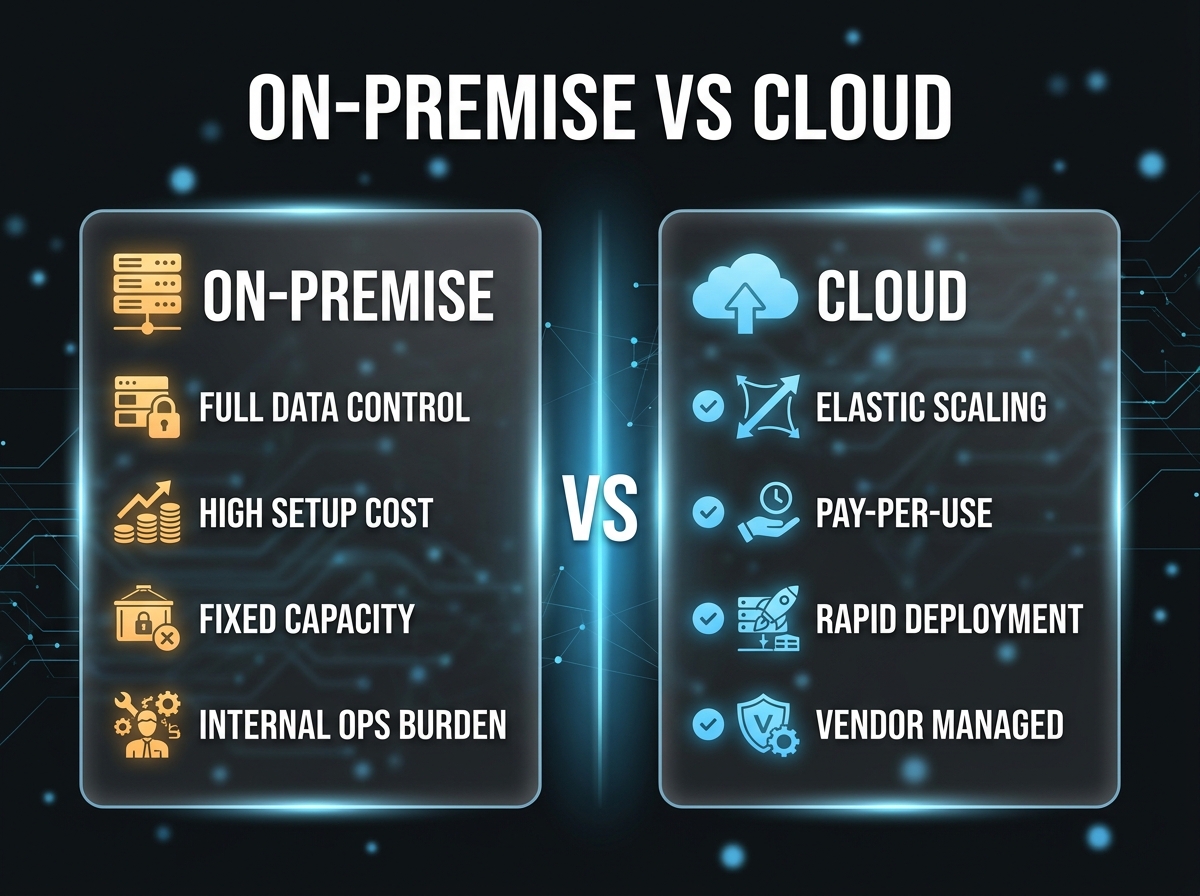

2. TCO & Kosten: Cloud-Modelle erscheinen im Piloten günstiger, weil die Infrastruktur entfällt. Bei hohem Volumen dreht sich das Bild: Pay-per-Token-Preise skalieren linear, GPU-Server amortisieren sich ab einer bestimmten Nutzungsintensität. On-Premise bindet Kapital und erzeugt fixe Betriebskosten — auch wenn das Modell nachts idle ist. Ein 3-Jahres-TCO-Modell sollte immer gerechnet werden, bevor eine Richtung festgelegt wird.

3. Latenz & Performance: Lokale Inferenz ist in der Regel schneller als API-Aufrufe über das Internet — besonders wenn hohe Gleichzeitigkeit gefragt ist. Für interne Wissensassistenten mit gespreiztem Nutzungsverhalten ist der Unterschied oft gering. Bei Echtzeit-Anwendungen (z. B. Live-Transkription, Kundeninteraktion mit Sub-Sekunden-Response) wird Latenz zum echten Differenzierungsmerkmal.

4. Modell-Kontrolle & Anpassbarkeit: On-Premise ermöglicht vollständiges Fine-Tuning auf eigenen Daten, proprietäre Systemanpassungen und unabhängige Modellversionen. Cloud-APIs bieten meist nur Prompt-Engineering und begrenzte Fine-Tuning-Optionen. Wer ein hochspezialisiertes Modell für spezifische Unternehmensterminologie oder regulierte Ausgaben braucht, gewinnt durch eigenen Betrieb erheblich mehr Spielraum.

5. Wartung & Betrieb: Selbst betriebene Modelle erfordern kontinuierliche Pflege: Sicherheits-Patches, Modell-Updates, Hardware-Monitoring, Incident-Response. Das ist realer Betriebsaufwand, der von einem qualifizierten Team geleistet werden muss — nicht nur zum Launch, sondern dauerhaft. Für Unternehmen ohne dediziertes ML-Ops-Team ist das oft der unterschätzte Kostentreiber. Cloud lagert diese Aufgaben an den Anbieter aus.

6. Skalierbarkeit & Flexibilität: Cloud-Infrastruktur skaliert elastisch — mehr Nutzer bedeuten mehr API-Calls, kein Kapazitätsengpass. On-Premise erfordert vorausschauende Hardware-Planung: Zu wenig Compute erzeugt Wartezeiten, zu viel bindet Kapital. Für Unternehmen mit unvorhersehbarer Nutzungsentwicklung ist Cloud hier klar im Vorteil.

Wann lohnt sich On-Premise wirklich?

On-Premise ist die richtige Wahl, wenn mindestens zwei der folgenden Bedingungen zutreffen: Das Unternehmen verarbeitet hochsensible Daten, für die keine Cloud-Verarbeitung vertretbar ist. Es gibt ein bestehendes IT-Team mit Erfahrung im GPU-Betrieb oder die Bereitschaft, dies aufzubauen. Das Nutzungsvolumen ist hoch und vorhersehbar genug, um die Hardware-Investition zu amortisieren. Eine starke Anpassung des Modells (Fine-Tuning, proprietäres Modell-Versioning) ist geplant.

Unternehmen in regulierten Branchen — Pharma, Finance, Versicherung — haben oft legitime Gründe für On-Premise. Der Fehler liegt aber darin, Datenschutz als einziges Argument zu verwenden, ohne die Betriebskosten ehrlich zu kalkulieren.

Wann ist Cloud die bessere Wahl?

Cloud passt für Unternehmen, die schnell starten wollen, keine ML-Ops-Kapazität haben und deren Datenprofil eine Cloud-Verarbeitung unter geeignetem AVV erlaubt. Auch für Proof-of-Concept-Phasen ist Cloud klar vorzuziehen: Kein Capex-Risiko, sofortige Verfügbarkeit, einfacher Modellwechsel. Viele Mittelständler beginnen mit Cloud und migrieren erst dann, wenn das Nutzungsvolumen den Break-even für eigene Hardware rechtfertigt.

Hybride Architekturen als praktikabler Mittelweg

Die Mehrheit der Unternehmen, die wir begleiten, landet nicht bei einem klaren Entweder-oder, sondern bei einer hybriden Architektur: Allgemeine Workloads — interne FAQ-Systeme, Dokument-Zusammenfassungen ohne vertrauliche Inhalte — laufen über Cloud-APIs. Sensible Prozesse — Legal-Review mit Vertragsdaten, HR-Anfragen mit Personaldaten — werden auf eigenem Compute betrieben oder über Private-Cloud-Instanzen (z. B. Azure Government, dedizierte Tenant-Isolation) abgewickelt.

Der entscheidende erste Schritt ist eine Datenklassifizierung: Welche Informationen fließen in welche LLM-Workflows? Daraus ergibt sich fast automatisch, wo Cloud akzeptabel ist und wo eigener Betrieb zwingend wird. Ohne diese Klassifizierung ist jede Deployment-Diskussion spekulativ.