Warum LLM-Budgets regelmäßig explodieren

Ein Maschinenbauer in Bayern beginnt im März mit einem Corporate-LLM-Projekt: Ein internes Assistenzsystem für den technischen Kundendienst, basierend auf einem führenden Cloud-Anbieter. Die initiale Kostenschätzung: 800 Euro pro Monat für API-Gebühren. Ergebnis nach acht Monaten: monatliche Kosten von über 6.400 Euro, dazu einmalige Entwicklungskosten von 47.000 Euro, die im ursprünglichen Business Case nicht auftauchten.

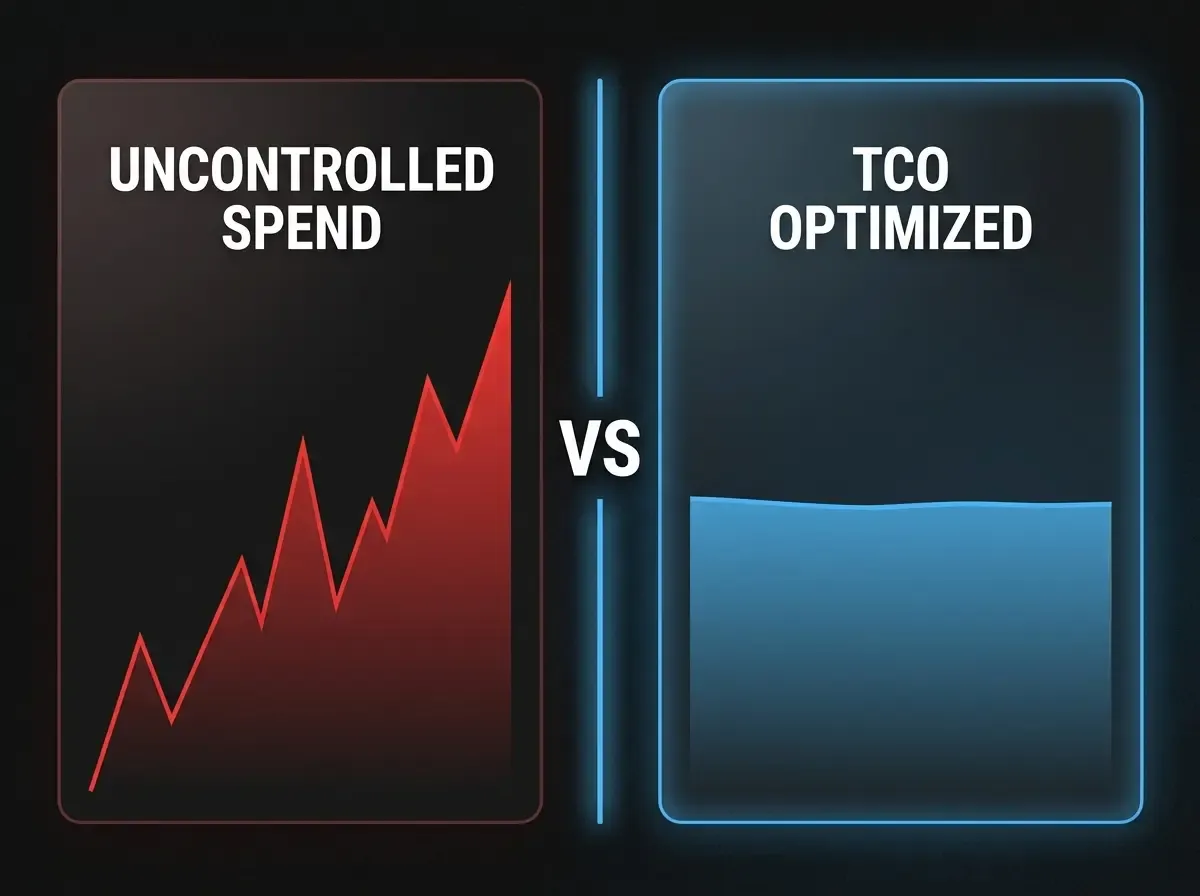

Dieses Szenario ist kein Ausreißer. In der Praxis unterschätzen Unternehmen die Gesamtkosten interner Sprachmodelle systematisch — weil sie die Kalkulation zu früh und zu eng ansetzen. API-Preise pro Token sind transparent und einfach zu verstehen. Die eigentlichen Kostentreiber sind es nicht: schlecht optimierte Prompts, die zehnmal mehr Token verbrauchen als nötig; fehlende Caching-Infrastruktur; unterschätzte Integrationsaufwände; und ein Betriebsmodell, das nach dem ersten Rollout mehr MLOps-Kapazität bindet als geplant.

Das Ergebnis: Viele LLM-Projekte sind technisch ein Erfolg, aber wirtschaftlich ein Problem. LLM Kosten Kalkulation im Unternehmen bedeutet deshalb nicht, einen Token-Preis mit einer Nutzungsschätzung zu multiplizieren. Es bedeutet, alle vier Kostenkategorien zu erfassen — bevor das erste Budget freigegeben wird.

LLM Kosten Kalkulation Unternehmen: Das TCO-Framework

Das folgende Framework strukturiert die Gesamtkosten eines internen LLM-Systems in vier Kategorien. Jede Kategorie hat eigene Kalkulationsgrößen, Optimierungshebel und typische Kostenanteilanteile am Gesamtbudget — basierend auf Projekterfahrungen aus dem DACH-Mittelstand.

Kostentreiber 1: Direkte Inference-Kosten

Dies ist der einzige Kostenpunkt, den die meisten Budgetplanungen erfassen. Inference-Kosten entstehen bei jeder LLM-Anfrage und werden typischerweise pro Token (Input + Output) abgerechnet. Bei führenden Cloud-Anbietern liegen die Preise für leistungsstarke Modelle derzeit zwischen 2 und 15 US-Dollar pro Million Input-Token und 8 bis 60 US-Dollar pro Million Output-Token — je nach Modellklasse und Anbieter.

Praktische Kalkulationsgröße: Ein mittelständisches Unternehmen mit 150 aktiven Nutzern, die täglich 10–20 LLM-Anfragen stellen, produziert pro Monat ca. 30–60 Millionen Token. Bei einem gehobenen Modell (12 US-Dollar / 1M Input-Tokens, 48 US-Dollar / 1M Output-Tokens) und einem durchschnittlichen Input/Output-Verhältnis von 3:1 ergibt sich ein monatlicher Inference-Betrag von 900 bis 1.800 US-Dollar — ohne jede Optimierung.

Wichtiger Hinweis: Inference-Kosten machen in der Praxis nur 20–40 % der tatsächlichen TCO aus. Die restlichen 60–80 % verstecken sich in den drei folgenden Kategorien.

Kostentreiber 2: Infrastruktur und Hosting

Wer ein LLM in die eigene Infrastruktur integriert, trägt zusätzliche Hosting-Kosten — auch wenn das Modell selbst über eine externe API aufgerufen wird. Dazu zählen: der Vector-Store für RAG-Systeme (z. B. Qdrant, Weaviate, Pinecone), eine Orchestrierungsschicht (z. B. LangChain, LlamaIndex, eigene Middleware), Compute-Ressourcen für Pre-Processing und Embedding-Berechnungen sowie Storage für Kontext, Session-Historie und Logs.

Typische monatliche Hosting-Kosten für ein mittelständisches Corporate-LLM-System: 300 bis 1.200 Euro bei Cloud-Hosting (AWS, Azure, GCP), abhängig von Nutzervolumen und Architekturkomplexität. Self-hosted Open-Weight-Modelle (z. B. Llama 3, Mistral) erfordern GPU-Instanzen; eine A100-Instanz auf AWS kostet ca. 3,50 US-Dollar pro GPU-Stunde — bei 720 Stunden/Monat und zwei GPUs ergibt sich ein Sockelbetrag von ca. 5.000 US-Dollar monatlich, unabhängig vom tatsächlichen Nutzungsvolumen.

Für Unternehmen, die Self-Hosting erwägen: Der Break-even gegenüber Cloud-APIs liegt erfahrungsgemäß bei ca. 5–10 Millionen Token pro Tag — ein Volumen, das die meisten Mittelständler im ersten Betriebsjahr noch nicht erreichen.

Kostentreiber 3: Integration und Entwicklung

Dies ist der am häufigsten unterschätzte Kostenpunkt. Die Integration eines LLM in bestehende Unternehmenssysteme (ERP, CRM, DMS, Intranet) ist kein Plug-and-play-Vorgang. Sie umfasst: API-Schnittstellen zu Quellsystemen, Daten-Preprocessing und Chunking für den Vector-Store, Zugriffsrechteverwaltung (wer darf welche Dokumente abfragen?), User Interface (Chatfenster, Slack-Bot, Teams-Integration), sowie die vollständige Evaluierungs- und Testinfrastruktur.

Realistische Entwicklungskosten für ein mittelständisches Erstsystem: 25.000 bis 80.000 Euro einmalig, abhängig von Systemkomplexität und interner Entwicklungskapazität. Werden externe Dienstleister eingesetzt, liegt der Aufwand typischerweise im oberen Bereich. Auf monatliche TCO umgerechnet (Amortisation über 24 Monate) ergeben sich 1.050 bis 3.300 Euro/Monat — ein Kostenpunkt, der in reinen API-Preisbetrachtungen vollständig fehlt.

Wichtig für die Kalkulation: Integrationskosten sind nicht linear. Ein zweites LLM-Projekt auf derselben Infrastruktur kostet in der Regel 40–60 % weniger als das erste, weil Infrastruktur, Governance-Rahmen und Entwicklungs-Know-how bereits vorhanden sind.

Kostentreiber 4: Laufender Betrieb und Hidden Costs

LLM-Systeme sind keine "Set and forget"-Applikationen. Nach dem Rollout entstehen laufende Betriebskosten, die in keinem initialen Budget auftauchen: Monitoring und Alerting (Antwortqualität, Latenz, Kosten-Anomalien), regelmäßige Evaluierungszyklen (Halluzinationsrate, Nutzerzufriedenheit), Index-Updates wenn sich die Wissensbasis ändert, Prompt-Optimierung wenn neue Modellversionen verfügbar werden, sowie Support und interne Schulungen bei wachsenden Nutzergruppen.

Erfahrungswert aus der Praxis: Der laufende Betrieb eines gut aufgesetzten Corporate-LLM-Systems bindet 0,5 bis 1,5 Personentage pro Monat in der IT — bei einfachen Systemen, die bereits mit soliden Monitoring- und Evaluierungsworkflows ausgeliefert wurden. Ohne diese Grundlage verdoppelt sich der Aufwand schnell.

Hidden Costs sind Kosteneffekte, die erst nach 6–12 Monaten sichtbar werden: Modell-Upgrades (wenn der Anbieter ein neues Modell einführt und das alte depreciert), steigende Nutzerakzeptanz (die zu unerwartetem Token-Wachstum führt), sowie Compliance-Aufwände durch den EU AI Act, der Dokumentations- und Auditpflichten für LLM-Systeme mit sich bringt.

Kostenoptimierung: Die vier wichtigsten Hebel

Sobald ein LLM-System in Betrieb ist, gibt es vier Stellschrauben, die die effektiven Kosten erheblich beeinflussen — ohne die Nutzererfahrung zu verschlechtern.

Hebel 1: Prompt-Optimierung und Kontext-Kürzung

Der System-Prompt und der mitgelieferte Kontext sind die größten Token-Kostentreiber in RAG-Systemen. Unkontrollierte Implementierungen liefern den gesamten abgerufenen Dokumentenkontext an das Modell — auch wenn 80 % davon irrelevant sind. Präzises Chunking, reranking der abgerufenen Passagen und komprimierte System-Prompts können den Input-Token-Verbrauch um 30–50 % senken, ohne die Antwortqualität messbar zu verschlechtern.

Hebel 2: Semantic Caching

In Unternehmensumgebungen sind viele Anfragen semantisch ähnlich oder identisch: "Wie lautet unsere Urlaubsregelung?" wird von 50 verschiedenen Nutzern auf 50 verschiedene Arten formuliert. Semantic Caching speichert LLM-Antworten auf häufige Anfragen und liefert gecachte Ergebnisse, ohne das Modell aufzurufen. In der Praxis lassen sich damit 20–40 % der monatlichen API-Aufrufe eliminieren — bei gleichzeitig niedrigerer Latenz für Endnutzer.

Hebel 3: Modell-Tiering

Nicht jede Anfrage erfordert das leistungsstärkste Modell. Ein mehrstufiges System leitet einfache Anfragen (Faktenabfragen, kurze Zusammenfassungen, Ja/Nein-Entscheidungen) an ein kleineres, günstigeres Modell weiter und reserviert das große Modell für komplexe Reasoning-Aufgaben. Die Preisdifferenz zwischen einem Mini-Modell und einem Full-Size-Modell kann den Faktor 10–20 betragen — bei entsprechendem Routing lassen sich 40–70 % der Inference-Kosten einsparen.

Hebel 4: Usage-Monitoring und Budget-Alerting

Das wirksamste Kostenkontroll-Instrument ist kein technisches Optimierungswerkzeug, sondern Sichtbarkeit. Wer weiß, welche Use Cases, welche Abteilungen und welche Nutzergruppen wie viele Token verbrauchen, kann gezielt eingreifen — bevor unkontrolliertes Wachstum zur Budget-Überschreitung wird. Empfehlung: Usage-Dashboard von Tag eins, monatliche Cost-Review mit dem verantwortlichen Business-Owner, automatisiertes Alerting bei Überschreitung von 80 % des Monatsbudgets.