Warum der EU AI Act für den Mittelstand 2026 Pflichten schafft, die nicht warten können

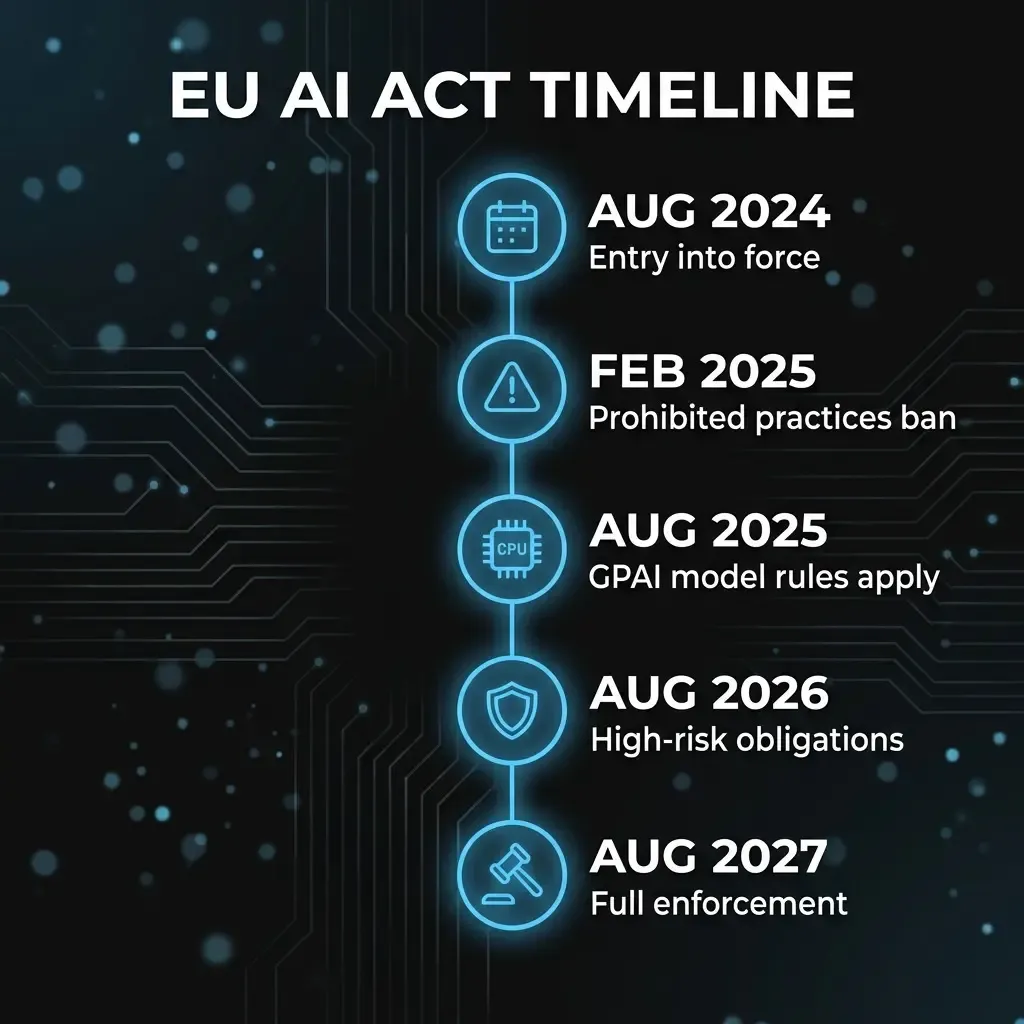

Die meisten Entscheider im deutschen Mittelstand haben vom EU AI Act gehört — aber die wenigsten wissen, ob ihre konkreten KI-Anwendungen betroffen sind. Die Verordnung (EU) 2024/1689, besser bekannt als EU AI Act, trat am 1. August 2024 in Kraft und entfaltet ihre Wirkung gestaffelt. Während das Verbot bestimmter KI-Praktiken seit Februar 2025 gilt, laufen die Übergangsfristen für Hochrisiko-Systeme und allgemeine KI-Modelle im Sommer und Herbst 2026 aus. Für Unternehmen, die EU AI Act Mittelstand Pflichten 2026 ernst nehmen, ist jetzt der Zeitpunkt zu handeln — nicht erst bei der nächsten Vorstandssitzung.

Das Besondere an dieser Regulierung: Sie richtet sich nicht nur an KI-Hersteller und Technologiekonzerne. Auch Betreiber — also Unternehmen, die KI-Systeme im eigenen Geschäftsbetrieb einsetzen — tragen klar definierte Pflichten. Wer ein KI-gestütztes Bewerbermanagement nutzt, wer Kreditentscheidungen algorithmisch unterstützt oder wer automatisierte Kundenklassifizierungen durchführt, ist potenziell Adressat der Verordnung. Im Mittelstand betrifft das mehr Anwendungen, als die meisten Geschäftsführungen vermuten.

Das Risikostufen-Modell: Wo steht Ihr Unternehmen?

Der EU AI Act klassifiziert KI-Systeme in vier Risikostufen — und die Einstufung bestimmt, welche Pflichten greifen. Für den Mittelstand sind vor allem zwei Stufen operativ relevant:

Inakzeptables Risiko (verboten): Systeme, die unterschwellige Manipulation einsetzen, Social Scoring betreiben oder biometrische Echtzeit-Identifizierung im öffentlichen Raum durchführen. Diese Verbote gelten bereits seit Februar 2025.

Hohes Risiko (streng reguliert): KI-Systeme in Bereichen wie Personalauswahl, Kreditvergabe, Versicherungs-Scoring, Bildung, kritische Infrastruktur und Strafverfolgung. Hier greifen ab August 2026 umfassende Pflichten für Anbieter und Betreiber: Risikomanagement, Datenqualität, technische Dokumentation, menschliche Aufsicht, Genauigkeit und Cybersicherheit.

Begrenztes Risiko (Transparenzpflicht): KI-Systeme, die direkt mit Personen interagieren — etwa Chatbots oder KI-generierte Inhalte. Hier muss kenntlich gemacht werden, dass eine KI im Einsatz ist.

Minimales Risiko (keine spezifischen Pflichten): Die Mehrheit der KI-Anwendungen — etwa Spam-Filter oder KI-gestützte Produktempfehlungen — fällt hierunter und bleibt weitgehend unreguliert.

Die Fristenlogik: Was wann greift

Die Verordnung entfaltet sich in Wellen. Für Mittelständler ist entscheidend zu verstehen, welche Pflichten bereits gelten und welche Deadlines unmittelbar bevorstehen:

Seit Februar 2025: Verbot inakzeptabler KI-Praktiken (Social Scoring, unterschwellige Manipulation, biometrische Echtzeit-Erkennung in öffentlichen Räumen). Betriebe müssen sicherstellen, dass keine ihrer Anwendungen in diese Kategorie fällt.

Seit August 2025: Regeln für Allzweck-KI-Modelle (General Purpose AI). Anbieter großer Sprachmodelle müssen technische Dokumentation, Urheberrechtsrichtlinien und Trainingsberichte vorlegen. Betreiber, die GPT-4, Claude oder Gemini via API einsetzen, sind indirekt betroffen, weil die Anbieter-Pflichten die Nutzungsbedingungen verändern.

Ab August 2026: Hochrisiko-Pflichten greifen vollständig. Betreiber müssen menschliche Aufsicht gewährleisten, automatisch erzeugte Logs aufbewahren, Betroffene über den KI-Einsatz informieren und Datenschutz-Folgenabschätzungen aktualisieren. Wer im HR-Bereich KI-gestütztes Screening einsetzt, braucht ab diesem Zeitpunkt ein dokumentiertes Risikomanagementsystem.

Ab August 2027: Vollständige Durchsetzung aller Bestimmungen, einschließlich der Pflichten für eingebettete KI in regulierten Produkten (Medizinprodukte, Maschinen, Fahrzeuge). Spätestens dann müssen alle Compliance-Lücken geschlossen sein.

Betreiberpflichten: Was Mittelständler konkret tun müssen

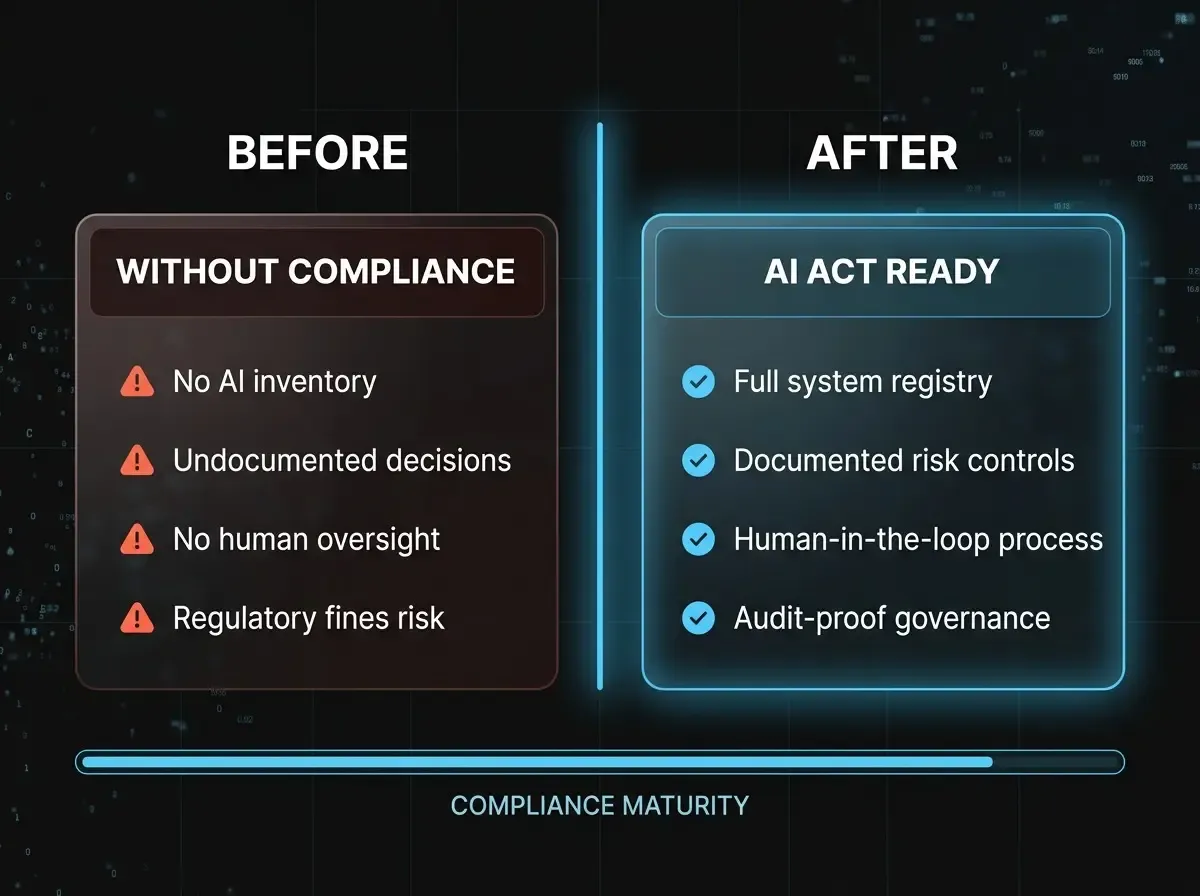

Ein verbreiteter Irrtum: Der EU AI Act betrifft nur KI-Hersteller. Tatsächlich definiert Artikel 26 der Verordnung klare Pflichten für Betreiber — also Unternehmen, die Hochrisiko-KI-Systeme in eigener Verantwortung einsetzen. Für den Mittelstand heißt das konkret:

Menschliche Aufsicht sicherstellen: Geschultes Personal muss die Outputs von Hochrisiko-KI-Systemen überwachen und bei Bedarf eingreifen können. Ein vollautomatischer Workflow ohne menschlichen Kontrollpunkt ist bei Hochrisiko-Einstufung nicht zulässig.

Log-Daten aufbewahren: Automatisch erzeugte Protokolle der KI-Systeme müssen mindestens sechs Monate gespeichert werden — soweit dies technisch in der Kontrolle des Betreibers liegt.

Betroffene informieren: Personen, die einer Hochrisiko-KI-Entscheidung unterliegen (Bewerber, Kreditantragsteller, Versicherungsnehmer), müssen darüber informiert werden, dass eine KI an der Entscheidung beteiligt war.

DSFA aktualisieren: Betreiber müssen ihre bestehenden Datenschutz-Folgenabschätzungen um die KI-spezifischen Risiken erweitern — insbesondere bei biometrischen Daten oder automatisierten Profilierungen.

Zweckbindung einhalten: KI-Systeme dürfen nur für den vorgesehenen Zweck und gemäß der Gebrauchsanweisung des Anbieters eingesetzt werden. Eigenständige Zweckänderungen machen den Betreiber zum Anbieter — mit deutlich umfangreicheren Pflichten.

Die pragmatische Checkliste: Fünf Schritte zur Compliance

Die folgenden Schritte bilden ein Minimalgerüst, das Mittelständler ohne externe Berater starten können — auch wenn bei Hochrisiko-Systemen eine juristische Begleitung empfehlenswert bleibt:

1. KI-Inventar erstellen: Erfassen Sie alle Systeme, die Entscheidungen treffen, Inhalte generieren oder Daten klassifizieren. Dazu gehören auch eingebettete KI-Funktionen in SaaS-Produkten, die auf den ersten Blick nicht als KI erkennbar sind.

2. Risikoeinstufung vornehmen: Prüfen Sie für jedes System, ob es in einen der Hochrisiko-Bereiche aus Anhang III der Verordnung fällt. HR-Screening, Bonitätsprüfung, Versicherungs-Scoring und Zugangskontrolle sind typische Treffer im Mittelstand.

3. Verantwortlichkeiten zuweisen: Definieren Sie, wer im Unternehmen für die menschliche Aufsicht, die Log-Aufbewahrung und die Information Betroffener zuständig ist. Ohne benannte Rollen bleibt Compliance ein Lippenbekenntnis.

4. Dokumentation aufbauen: Halten Sie für jedes Hochrisiko-System fest, welchen Zweck es erfüllt, welche Daten es verarbeitet, wie die menschliche Aufsicht organisiert ist und welche Maßnahmen bei Fehlfunktionen greifen.

5. Frühwarnsystem einrichten: Definieren Sie Schwellenwerte und Eskalationspfade für den Fall, dass ein KI-System fehlerhafte oder diskriminierende Ergebnisse produziert. Der EU AI Act verlangt, dass schwerwiegende Vorfälle innerhalb definierter Fristen an die zuständige Marktaufsichtsbehörde gemeldet werden.

Bußgelder und Durchsetzung: Wie ernst ist die Lage?

Der EU AI Act sieht ein abgestuftes Bußgeldsystem vor, das auch für mittelständische Unternehmen empfindliche Summen erreichen kann. Bei Verstößen gegen verbotene KI-Praktiken drohen bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes — je nachdem, welcher Betrag höher ist. Verstöße gegen Hochrisiko-Pflichten können mit bis zu 15 Millionen Euro oder 3 % des Umsatzes geahndet werden.

Für KMU und Start-ups sieht die Verordnung zwar verhältnismäßigere Bußgelder vor, doch „verhältnismäßig" bedeutet nicht „vernachlässigbar". Die Marktaufsicht wird in Deutschland voraussichtlich bei der Bundesnetzagentur angesiedelt, die bereits erste Strukturen aufbaut.

Mindestens ebenso relevant: Reputationsrisiken. Wenn bekannt wird, dass ein Unternehmen automatisierte Entscheidungen ohne menschliche Aufsicht und ohne Information der Betroffenen trifft, ist der wirtschaftliche Schaden oft größer als das Bußgeld selbst.

Fazit: Pragmatismus schlägt Abwarten

Der EU AI Act ist keine ferne Zukunftsmusik, sondern geltendes Recht mit greifbaren Fristen. Für Mittelständler, die KI bereits operativ einsetzen, ist die Bestandsaufnahme der erste und wichtigste Schritt. Wer seine Systeme klassifiziert, Verantwortlichkeiten benennt und Dokumentation aufbaut, schafft nicht nur Compliance — sondern auch eine belastbare Grundlage für den weiteren KI-Ausbau. Die Unternehmen, die jetzt handeln, sind nicht die Überregulierten. Sie sind diejenigen, die KI auch unter regulatorischen Rahmenbedingungen sicher skalieren können.